OpenAI 的首批开源 GPT 模型(200 亿和 1200 亿参数)现已登陆 Gradient AI 平台。此次发布让开发者在构建 AI 应用时拥有更高的灵活度和更多选择,无论是快速原型还是大规模生产级智能体,都能轻松上手。

新特性

开源 GPT 模型:可直接在 Gradient AI 平台调用 gpt-oss-20b 与 gpt-oss-120b。

代码 + UI 双支持:既可通过 Serverless Inference API 调用,也可在创建智能体时于控制台直接选择,或在模型沙盒中实时体验。

一体化体验:统一计费、可观测性与可追溯性,无需再整合多家供应商、账单或监控工具。

两种方法进行部署

通过代码方式

通过 Serverless Inference API 直接调用。

import os

import sys

from gradient import Gradient

model_access_key = os.environ.get("GRADIENT_MODEL_ACCESS_KEY")

if not model_access_key:

sys.stderr.write("错误:未设置环境变量 GRADIENT_MODEL_ACCESS_KEY。\n")

sys.exit(1)

inference_client = Gradient(model_access_key=model_access_key)

inference_response = inference_client.chat.completions.create(

messages=[

{

"role": "user",

"content": "为一款环保水瓶写一段产品描述。",

}

],

model="openai-gpt-oss-20b",

)

print(inference_response.choices[0].message.content)

通过用户界面的方式

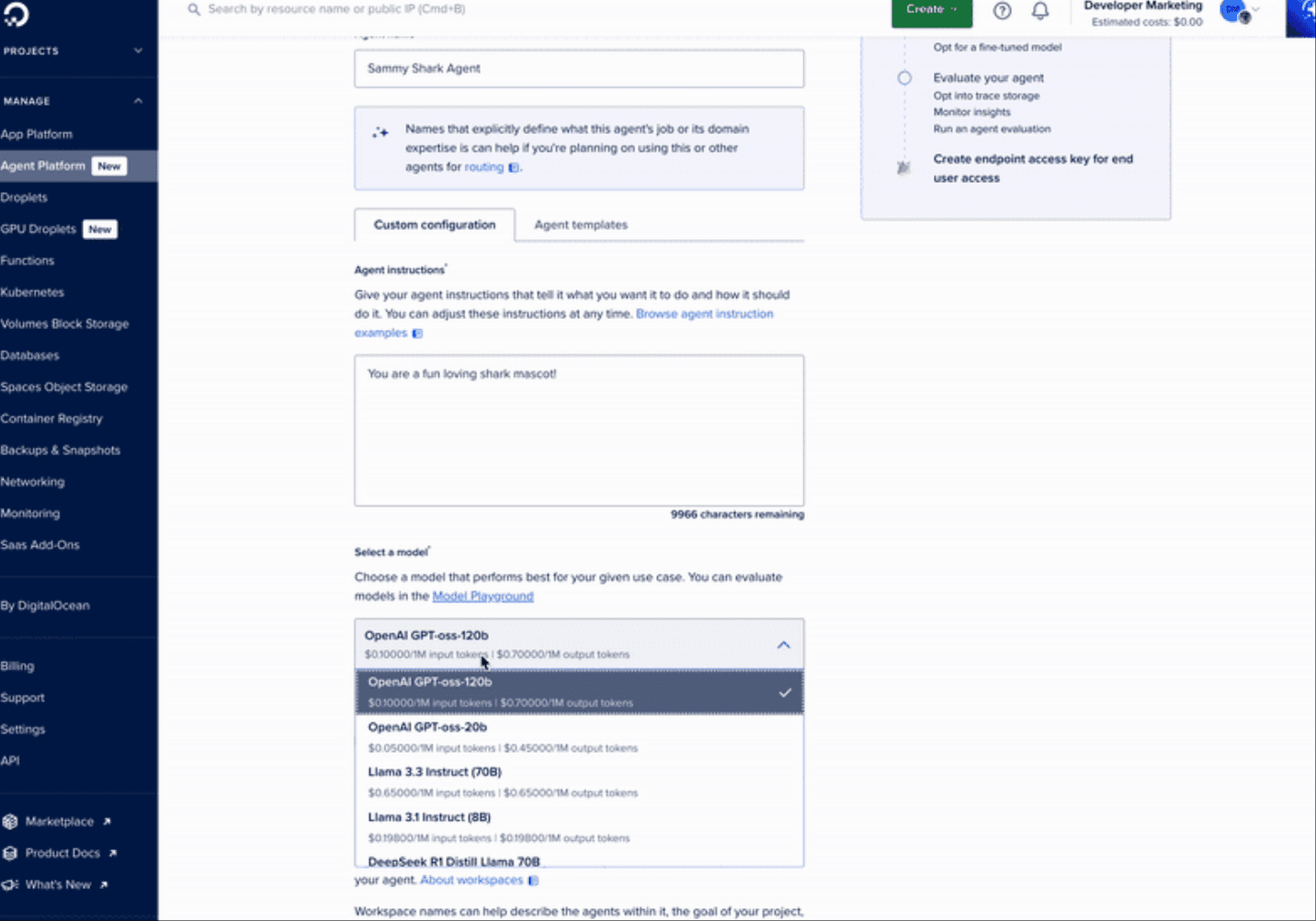

进入「创建智能体」页面,在模型下拉框中选择 gpt-oss-20b 或 120b 即可。

基于DigitalOcean Gradient AI平台与gpt-oss,可构建的场景包括:

-

基于自有知识库训练的客户支持智能体

-

成本优化的内容生成工具

-

兼顾性能与价格的 AI 应用

本次发布让 Gradient AI 平台朝着「最简单、最灵活的生产级 AI 应用构建方式」又迈进了一步。在 Gradient AI 平台上,我们提供了包括 H200、H100、MI325X、MI300X、L40s 等一系列 GPU 按需实例与裸金属服务器,如需了解详情,可咨询 DigitalOcean 中国区独家战略合作伙伴卓普云aidroplet.com。