很多人都会在知乎或者论坛中询问“如果 DeepSeek 本地部署,应该怎么选 GPU?”,或者是问“我要是部署DeepSeek R1,那需要最低多少张 H100 或 A100?”。似乎大家优先考虑的都是 GPU 的型号,但是总忽略一个指标——GPU 的内存带宽。这个指标其实是会对你的大语言模型的性能起到关键作用。在部分情况下,你甚至需要基于这个指标来做 GPU 的选型。选对了 GPU,不仅事半功倍,还可能节省成本。

本文将解释 GPU 内存带宽是什么、它为什么重要,以及它如何影响深度学习工作负载。了解内存带宽可以帮助机器学习团队在 GPU 服务器时做出明智的决策。

顺带一提,DigitalOcean 的 GPU Droplet 服务器是一个可扩展且高性能计算的绝佳选择。它提供了包括A100、H100、H200等十几种 GPU ,包括按需付费的云实例与裸金属机型,如感兴趣可联系我们。GPU Droplet 提供以下:

- 高带宽内存,能够高效处理大型数据集。

- 优化的 AI/ML 工作负载性能,减少训练时间。

- 可扩展性,以满足不断增长的计算需求,无需前期硬件成本。

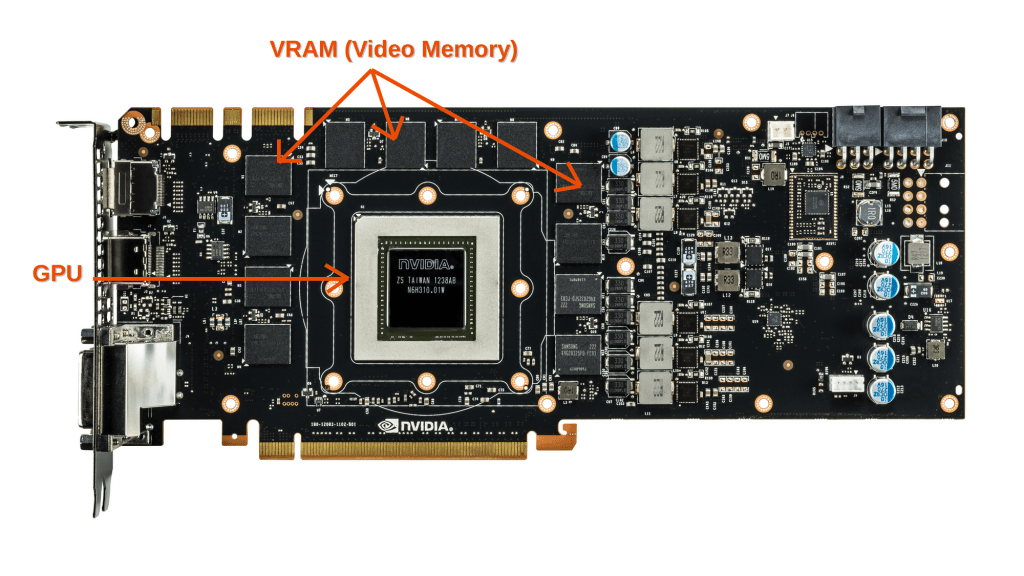

GPU 的基本组成

显卡类似于主板,是一种印刷电路板,上面有处理器、内存和电源管理单元。它还包含一个 BIOS 芯片,用于存储显卡的设置,并在启动时对内存和输入输出组件进行诊断。

显卡上的 GPU 与计算机主板上的 CPU 类似。然而,GPU 是专门设计用来处理图形渲染和其他机器学习应用所需的复杂数学和几何计算。

在显卡中,计算单元(GPU)通过称为内存接口的总线连接到内存单元(VRAM,即视频随机存取存储器)。

在计算机系统中,有多个内存接口。内存接口是与 GPU 相关的内存总线的物理位宽。数据在每个时钟周期(每秒数十亿次)被发送到和从显卡内存传输。每个时钟周期沿总线可以容纳的位数就是这个接口的宽度,通常被描述为“384位”等。384位内存接口允许每个时钟周期传输384位数据。因此,在确定 GPU 上的最大内存吞吐量时,内存接口也是内存带宽计算的重要组成部分。因此,NVIDIA 和 AMD 更倾向于在其显卡中使用标准化的串行点对点总线。POD125 标准被 NVIDIA Ampere 系列显卡 A4000、A5000 和 A6000 使用,这实际上描述了与 GDDR6 VRAM 的通信协议。

另一个需要考虑的内存带宽因素是延迟。最初,像 VMEbus 和 S-100 总线这样的通用总线被实施,但现代内存总线被设计为直接连接到 VRAM 芯片以减少延迟。

GDDR5 和 GDDR6 是最新的 GPU 内存标准之一。每种内存类型由两个芯片组成,每个芯片配备一个 32 位总线(由两个并行的 16 位总线组成),这使得可以同时进行多次内存访问。因此,具有 256 位内存接口的 GPU 将使用八个 GDDR6 内存芯片。

另一类内存类型是 HBM(高带宽内存)和 HBM2。每个 HBM 接口具有 1024 位带宽,通常比 GDDR5 和 GDDR6 提供更高的性能。

主板和显卡之间的外部 PCI-Express 连接不能与此内部内存接口混淆。这个总线也以其带宽和速度为特征,尽管它在数量级上更慢。

什么是 GPU 内存带宽?

GPU 的内存带宽决定了它能多快地将数据从内存(VRAM)移动到计算核心。它比 GPU 内存速度更具代表性。它由内存和计算核心之间的数据传输速度以及这两部分之间总线中的并行链接数量决定。

自20世纪80年代初以来,家用电脑的内存带宽绝对值约为1 MB/s,消费设备的带宽显著增加——增加了几个数量级。然而,可用计算资源的增长速度超过了带宽的增加。为了避免频繁达到带宽限制,确保工作负载和资源在内存大小和带宽方面匹配至关重要。

让我们来看看最先进的面向 ML 的 GPU 之一,NVIDIA RTX A4000。它配备 16 GB GDDR6 内存、256 位内存接口(GPU 和 VRAM 之间总线上的独立链接数量)和令人惊讶的 6144 个 CUDA 核心。凭借所有这些与内存相关的特性,A4000 的内存带宽可达到 448 GB/s。

这里还列出了一些其他流行的 GPU 规格:

| GPU | VRAM | 内存接口宽度 | 内存带宽 |

|---|---|---|---|

| P4000 | 8 GB GDDR5 | 256 位 | 243 GB/s |

| P5000 | 8GB GDDR5X | 256 位 | 288 GB/s |

| P6000 | 24GB GDDR5X | 348 位 | 432 GB/s |

| V100 | 32GB HBM2 | 4096 位 | 900 GB/s |

| RTX4000 | 8GB GDDR6 | 256 位 | 416 GB/s |

| RTX5000 | 16GB GDDR6 | 256 位 | 448 GB/s |

| A4000 | 16GB GDDR6 | 256 位 | 448 GB/s |

| A5000 | 24GB GDDR6 | 348 位 | 768 GB/s |

| A6000 | 48GB GDDR6 | 348 位 | 768 GB/s |

| A100 | 80GB HBM2 | 5120 位 | 1555 GB/s |

为什么机器学习应用需要高内存带宽?

内存带宽的影响可能并不立即明显。当带宽不足时,它会形成瓶颈,导致数千个 GPU 计算核心在等待内存数据时保持空闲。此外,根据应用的需求,GPU 可能需要多次处理数据块(假设为 T 次)。在这种情况下,外部 PCI 带宽应至少为 GPU 内部带宽的 1/T,以避免延迟。最常见的 GPU 使用情况突出了前面提到的限制。例如,在训练模型时,程序将训练数据加载到 GDDR 内存中,并在计算核心中多次通过神经网络层,通常运行数小时。因此,PCI 总线带宽与 GPU 内部带宽的比例可能高达 20 比 1。

所需的内存带宽完全取决于你正在进行的项目类型。例如,如果你正在处理一个依赖于大量数据被馈送、重新处理和持续恢复到内存中的深度学习项目,那么你将需要更宽的带宽。对于基于视频和图像的机器学习项目,内存和带宽要求并不像自然语言或声音处理项目那样低。对于大多数平均项目,300 GB/s 到 500 GB/s 是一个不错的参考值。这并不总是如此,但通常足以容纳广泛的视觉数据机器学习应用。

让我们来看一个深度学习内存带宽需求验证的例子:

在考虑具有超过 2500 万个权重参数的 50 层 ResNet 时,使用 32 位浮点数存储每个参数,我们发现它需要大约 0.8 GB 的内存。因此,在 mini-batch 大小为 32 的情况下进行并行计算时,每个模型传递大约需要 25.6 GB 的内存。

对于像 A100 这样的 GPU,其计算能力为 19.5 TFLOPs,ResNet 模型在单次传递中消耗 497 GFLOPs(特征大小为 7 x 7 x 2048)。GPU 每秒可以完成大约 39 次完整的传递,导致带宽需求为 998 GB/s。然而,由于 A100 的带宽为 1555 GB/s,它可以高效地管理此模型而不会遇到任何瓶颈。

如何优化模型以降低内存带宽使用?

一般来说,机器学习算法,特别是计算机视觉领域的深度神经网络,会带来较大的内存和内存带宽占用。可以使用一些技术在资源受限的环境中部署 ML 模型,甚至在强大的云 ML 服务中也可以降低成本和时间。以下是可实施的一些策略:

部分拟合:当数据集太大,无法在单次传递中处理时,可以分阶段拟合模型,而不是同时处理所有数据。这种方法允许你取一部分数据,拟合模型以生成权重向量,然后继续处理下一部分数据。这个过程不断重复,每部分数据都为创建新的权重向量做出贡献。不用说,这降低了 VRAM 的使用,同时增加了训练时间。最显著的缺陷是,并非所有算法和实现都使用部分拟合或可以技术上进行调整以实现这一点。尽管如此,只要可能,仍应考虑这一点。

降维:这不仅对于减少训练时间很重要,而且对于减少运行时的内存消耗也很重要。一些技术,如主成分分析(PCA)、线性判别分析(LDA)或矩阵分解,可以显著降低维度,并产生具有较少特征的输入变量子集,同时保留原始数据的一些重要特性。

稀疏矩阵:在处理稀疏矩阵时,仅存储非零条目可以节省大量内存。根据非零项的数量和分布,可以使用不同的数据结构,与基本方法相比,可以节省大量内存。其权衡关键在于,访问单个元素变得更具挑战性,并需要额外的辅助结构来无歧义地还原原始矩阵,这需要以更高的核心计算开销来换取更低的内存带宽占用。

一些常见的疑问

1、什么是 GPU 内存 带宽?

GPU 内存带宽是指 GPU 与内存(VRAM)之间传输数据的速率。它以每秒千兆字节(GB/s)为单位测量,在处理大型数据集、实时渲染和 AI/ML 工作负载方面起着关键作用。更高的带宽允许更快的数据传输,从而提高整体性能。

2、如何计算 GPU 内存 带宽?

GPU 内存带宽使用以下公式计算:

- 内存带宽 = 内存总线宽度 × 内存速度 × 数据率

- 内存总线宽度(以位为单位):内存接口的宽度,例如 128 位、256 位或 512 位。

- 内存速度(以 GHz 为单位):内存模块的时钟速度。

- 数据率:每个时钟周期的数据传输次数(例如,GDDR6X 内存的数据率高于 GDDR6)。

例如,一个具有 256 位总线、16 Gbps 内存速度和 GDDR6 内存(双倍数据率 2)的 GPU 将具有:256×16×2/8 = 512 GB/s 的内存带宽。

3、为什么 GPU 内存 带宽重要?

内存带宽决定了 GPU 访问和处理数据的速度,影响以下方面的性能:

- 机器学习——更快的模型训练和推理。

- 游戏——更流畅的渲染,尤其是在高分辨率和高刷新率设置下。

- 视频编辑和 3D 渲染——更快地加载纹理和资源。

- 科学计算——改进模拟的数据处理。

具有高内存带宽的 GPU 可提供更流畅的性能,尤其是在处理大型数据集时。

4、 内存 类型如何影响带宽?

不同类型的 GPU 内存提供不同的带宽能力:

- GDDR6——常见于游戏和工作站 GPU,提供良好的带宽。

- GDDR6X——在高端 GPU 如 RTX 3090 中使用,提供更快的数据传输。

- HBM(高带宽内存)——用于 AI 和数据中心 GPU(例如 AMD MI300X),由于更宽的内存总线和堆叠架构,提供更高的带宽。

5、 内存 带宽与内存大小( VRAM )有何不同?

VRAM(内存大小)决定了可以同时存储多少数据。具有更多 VRAM 的 GPU 可以处理更大的数据集。内存带宽决定了数据传输的速度。即使 GPU 拥有大量 VRAM,如果其带宽低,也会成为瓶颈。对于游戏,VRAM 对于高分辨率纹理至关重要,而对于 AI/ML,内存带宽通常是更大的性能因素。

6、可以增加 GPU 内存 带宽吗?

直接增加内存带宽是不可能的,但你可以通过以下方式优化使用:超频 VRAM(如果支持,需谨慎)。使用优化算法减少内存瓶颈。使用高带宽云 GPU,如 DigitalOcean GPU Droplet,提供 H100 GPU,具有卓越的内存性能。

7、哪些 GPU 具有最高的 内存 带宽?

一些带宽最高的 GPU 包括:

- NVIDIA H100——3.35 TB/s(HBM3e 内存)

- AMD Instinct MI300X——5.3 TB/s(HBM3 内存)

- NVIDIA A100——2.0 TB/s(HBM2e 内存)

- NVIDIA RTX 4090——1.0 TB/s(GDDR6X 内存)

这些 GPU 专为 AI、机器学习和高性能计算设计。

8、 内存 总线宽度如何影响带宽?

内存总线宽度是每个周期可以传输的位数。更宽的总线允许同时处理更多数据,增加带宽。例如:

- 128 位总线(RTX 4060)→ 较低的带宽。

- 384 位总线(RTX 4090)→ 较高的带宽。

- 4096 位总线(HBM 驱动的 GPU)→ 为 AI 工作负载提供极端带宽。

9、 内存 速度(时钟速度)在带宽中扮演什么角色?

内存时钟速度决定了数据读写的速度。更高的速度意味着每秒更多的数据传输,增加带宽。然而,内存类型(例如 GDDR6 与 HBM)和总线宽度影响整体性能。

10、 GPU 内存 带宽如何影响游戏性能?

更高的带宽允许更快地加载纹理和更流畅的帧率。这对于高分辨率(1440p/4K)游戏至关重要,需要快速处理大量纹理。在开放世界游戏中,这一点更为重要(例如《赛博朋克 2077》、《微软飞行模拟器》)。

11、对于 AI 和 机器学习 , 内存 带宽比 VRAM 更重要吗?

对于 AI/ML 工作负载,内存带宽通常比 VRAM 大小更重要。AI 模型需要在内存和处理核心之间快速移动数据,因此高带宽对于效率至关重要。对于大型模型,带宽和 VRAM 都很重要,但像 NVIDIA H100(带宽 3.35 TB/s)这样的 GPU 由于能够高效处理大规模并行计算而更胜一筹。DigitalOcean GPU Droplet 为基于云的 AI 工作负载提供高带宽 GPU,确保更快的模型训练和推理,而无需硬件限制。

结论

了解 GPU 内存带宽对于优化机器学习模型至关重要。它在很大程度上决定了数据传输的速度,直接影响模型训练速度、推理效率和整体计算性能。

对于那些寻求性能并希望精准控制成本的 AI 团队来说,DigitalOcean GPU Droplet 服务器提供了一个更加适合的解决方案。凭借 NVIDIA H100 、H200 等高带宽 GPU,你可以高效地训练深度学习模型、处理大型数据集,并扩展工作负载,而无需前期在硬件上投入大量成本。通过利用 DigitalOcean 基于云的 GPU 服务,你可以优化成本,同时确保模型运行平稳且高效。如感兴趣可联系我们。