如果你一直关注人工智能领域的最新发展,很可能听说过模型上下文协议(MCP)。它于 2024 年 11 月首次亮相时,并没有引起多少关注。而到了 2025 年 5 月,突然成为社交媒体、知乎、reddit 、Bilibili 和抖音上的热门话题。为什么会这样呢?因为 MCP 代表着我们与人工智能系统交互方式的根本性转变。它绝非简单的渐进式更新,而是一种全新的构想,能够让人工智能在现实世界中真正发挥作用,而不仅仅是生成文本。

可以说,MCP 就是我们许多人一直在等待的桥梁。它能让DeepSeek、Claude、Qwen 这样的人工智能从仅仅提供建议,转变为卷起袖子与你并肩协作。在本文中,我们将带你深入了解 MCP 究竟是什么,它是如何改变(甚至可以说变革)各种工作流程的,以及最重要的是,即使你没有技术背景,也能看懂如何自己实现 MCP。

什么是模型上下文协议(MCP)?

模型上下文协议(MCP)于 2024 年 11 月首次亮相时并未引起太多轰动,但到了 2025 年 3 月,社交媒体、知乎、reddit 、Bilibili 和抖音上所有人都在谈论它,尤其是那些关注 AI 行业的博主。更重要的是,这与人工智能开发以及构建流程标准化的需求相辅相成。MCP 为组织、规划和执行编码项目提供了工具,打开了开发的便利之门。

最具争议性的 MCP 服务器之一是文件系统,它让你可以自主创建、删除、移动和整理文件与目录。这意味着,一旦安装,你可以直接修改 config.json 文件并轻松添加 MCP 服务器。

更妙的是,当某些 MCP 服务器部署完成后,添加和格式化其他工具的过程基本相同。最初最大的障碍是正确配置 MCP 服务器以实现连接,但很快我发现一个技巧:客户端(如 Claude Desktop)可以自动完成这项工作。正是依靠这一点,即使我对 IDE、编程或框架一无所知,我也成功在 DigitalOcean App Platform应用托管平台上构建并部署了一个定制化的 Web 应用。后续会详细介绍。

MCP 的现实应用场景

当谈到 MCP 的实用价值时,理解它如何帮助企业提升效率至关重要。以下是五个亲测有效的应用场景:

- 邮件与日历管理

对于服务提供商和课程创作者而言,沟通管理耗时巨大。MCP 可让 AI 助手起草个性化邮件、分类信息、根据你的可用时间安排会议,并自动发送跟进提醒。相比仅提供文字建议,MCP 赋予助手直接访问邮箱系统的能力,以最小的人工干预完成全流程操作。

- 内容创作与管理

对于定期发布内容的企业,MCP 将 AI 从创意生成器转变为生产合作伙伴。它可以研究热点话题、撰写符合品牌语调的内容、跨平台按最佳时间发布,甚至将现有内容重新加工为新形式。区别在于:无需手动复制粘贴 AI 建议,MCP 让助手直接对接你的内容管理系统。

- 项目管理

Asana 或 Trello 等项目平台在与 MCP 整合后威力倍增。你可以基于讨论结果自动生成任务、自动追踪截止日期、生成进度报告、提前识别瓶颈,并在需要时建议资源重新分配。这意味着 AI 助手成为主动的项目经理,而非仅仅是提供建议的工具。

- 销售与营销辅助

对于注重增长的企业,MCP 让 AI 深度参与销售流程:更新 CRM 记录、分析潜在客户数据以制定个性化外联策略、监控活动效果、生成跟进内容,并根据预设标准筛选合格线索。相比单纯提供文案建议,MCP 助手可以直接实施近期活动的数据洞察。

- 多系统工作流自动化

MCP 最强大的应用在于打破企业系统的孤岛。它可以同步营销、销售和履约部门的数据,自动化跨多平台的复杂工作流,无需编程即可创建定制化集成方案,设定触发式动作,并在所有操作中保持数据一致性。这种深度整合此前需要高昂的定制开发成本,而如今通过 MCP 启用的 AI 助手即可实现。

部署选项

MCP 服务器大多以本地部署为主。如果你想将其托管在云端,DigitalOcean 提供了便捷的解决方案:App Platform 和 Droplets 云服务器可轻松改造 MCP 服务器,使其更像 REST API。

这种模式在以下场景中具有优势:

- 缺乏所需客户端

- 硬件性能不足

- 需要临时访问

此外,DigitalOcean 命令行接口(doctl)可无缝实现从终端构建和部署。这意味着,即使是新手开发者,也不必担心部署过程。如果你使用 BHT Labs 自定义服务器等支持运行命令工具的 MCP 服务器,甚至可以通过 LLM 直接输入简单指令完成部署。这一过程完全无感,为测试工具共享提供了新机会(无需考虑本地构建限制)。

框架与资源

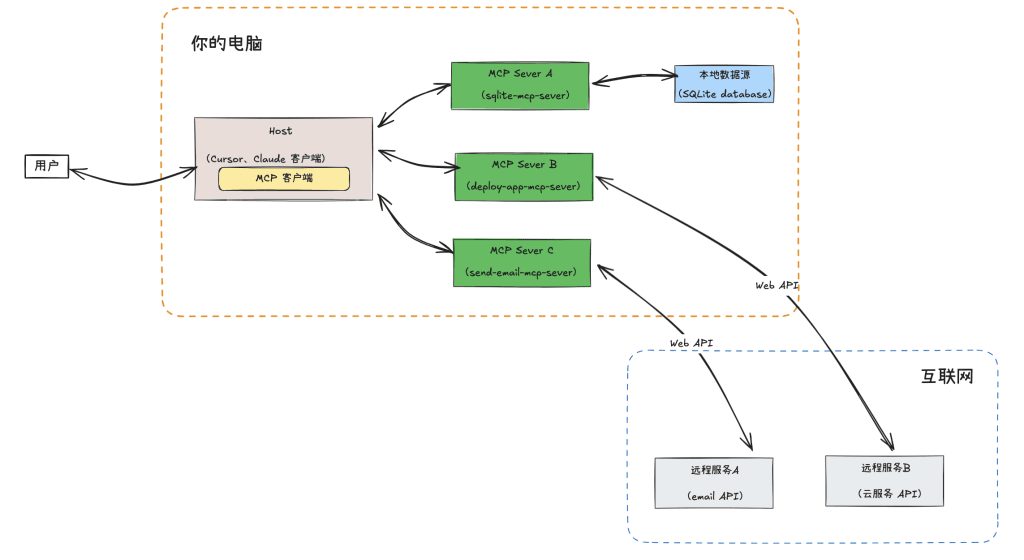

这是我构建第一套工具的基础框架。本质上,MCP 客户端让你能够访问所有必要的工具,从而利用这些实用功能。而“组织化 AI”这一理念的核心是只使用必要工具,并在测试和生产阶段保持良好的维护习惯。尤其在 AI 技术快速迭代的当下,临时下载安装包和工具已成常态。

我遇到的一个问题是,许多企业都会面临:本地部署 AI 解决方案可能会加重机器负担。除非你是软件和硬件专家,否则可能难以理解这对工作效率的影响。我在安装和尝试不同 AI 工具组合时,多次收到内存占用警告,许多网页应用就是罪魁祸首。这些工具确实强大,但若非技术背景出身,很难意识到它们对硬件的消耗有多大。

额外应用

另一个我感兴趣的用例是 Mermaid MCP 服务器。它允许我将想法、概念甚至整个项目转化为团队成员易于理解的图表——尤其是那些对项目各环节关联性不了解的人。即使作为思考工具,视觉化展示事物的连接关系和项目各阶段,也能带来巨大帮助。

关于在 LLM 和 AI 工具中使用 MCP 服务器进行编码和产品管理,我想说的是:它让我变得更擅长规划。因为我能更快地将自己的想法输出为清晰、易懂的格式。

常见问题解答

1、什么是 MCP ?

MCP 代表模型上下文协议,一种标准化协议,允许人工智能应用程序与外部工具和数据源进行交互。它为人工智能模型提供了一种标准化的方法,使其不仅可以生成文本,还可以执行诸如查询数据库、发送电子邮件和自动化工作流程等任务,使它们更具多功能性和实用性。

2、我为什么要使用 MCP ?

MCP 使人工智能模型能够执行超出文本生成的任务,例如查询数据库、发送电子邮件和自动化工作流程,从而使它们更具多功能性和实用性。它允许与各种工具和数据源无缝集成,增强人工智能模型的能力并提高其效率。

3、如何设置 MCP 服务器?

你可以通过在线教程来设置 MCP 服务器,例如 DigitalOcean 提供的教程,该教程指导你如何使用 Python 构建服务器。该过程包括设置服务器、配置工具和数据源以及与人工智能模型建立连接。

4、MCP 可用于商业应用吗?

是的,MCP 可用于各种商业应用,包括电子邮件管理、内容创作、项目管理、销售协助和工作流程自动化。MCP 提供了一种标准化的方法,将人工智能模型与这些商业应用集成,增强其能力并提高其效率。

5、是否可以在云端部署 MCP 服务器?

是的,MCP 服务器可以部署在云端平台,如 DigitalOcean 的应用托管平台(App Platform)或Droplet云服务器上,从而实现远程访问和可扩展性。这使得服务器的管理和扩展更加容易,并在访问和使用方面提供了更大的灵活性。

6、本地运行 MCP 的硬件要求是什么?

本地运行 MCP 需要一台具有足够处理能力和内存的计算机,因为人工智能解决方案可能非常耗费资源。具体要求可能因使用的特定工具和数据源而异,但一般来说,一台具有足够内存和现代 CPU 的计算机就足够了。

7、使用 MCP 是否有任何限制?

尽管 MCP 功能强大,但它需要一个客户端才能运行,本地部署可能会面临硬件限制。此外,对于非技术用户来说,理解技术设置可能具有挑战性。然而,借助合适的资源和支持,这些限制可以克服,并且可以充分利用使用 MCP 的优势。

小结

综上所述,MCP 服务器看似技术复杂且专注于 AI 开发与编程,但对于希望在工作场景中利用 AI 功能的企业主而言,它却是一个极具价值的应用案例。通过将专用客户端连接至内部网络并确保 AI 工具的安全性,MCP 服务器能够有效预防潜在问题。如果你是企业主,请考虑采用“系统化 AI”(Organized AI)理念,让 AI 在业务流程中发挥更大作用。

最后,如果你正在研究 AI 大模型,比如DeepSeek、Qwen等,在训练或推理阶段遇到性能瓶颈,欢迎了解DigitalOcean 的 GPU 服务器(含裸金属服务器),按需计费且价格低于所有一线云服务平台。