很多开发者为了追求极致的代码理解力,会订阅多个大模型,但往往面临“订阅费昂贵”和“模型切换麻烦”的痛点。其实,对于追求高效率的开发者来说,DigitalOcean 推理云平台的 Gradient Serverless Inference 提供了一个非常便捷的方法:它提供了一套标准化的 API 接口,让你能以一个 API、按量计费的方式,在编辑器里直接调用 Opus 4.6、Qwen3 等多个顶级大模型。

你不需要为每个模型单独支付月费。通过 Continue.dev 或 Kilo Code 插件,你可以把 Gradient 当成一个强大的算力后台——复杂的架构设计交给 Opus或Sonnet,日常的逻辑实现交给 Qwen。

今天我就带大家打通这条路径,把 VS Code 真正变成一个“全模型集成”的开发大本营。

操作步骤

首先准备好Gradient Serverless Inference服务的Model Key。

首先注册 DigitalOcean 推理云平台账号。进入后台之后点击侧边栏的 Gradient AI 平台按钮,选择下图中的“Serverless Inference”,然后创建 Access Key。如果希望通过API的方式来创建,可阅读卓普云官网博客的教程。

Continue插件配置

在VScode里扩展里搜索并安装Continue插件, 点击安装

配置Continue插件

在左侧边栏找到Continue插件,选中后点击右上角的设置

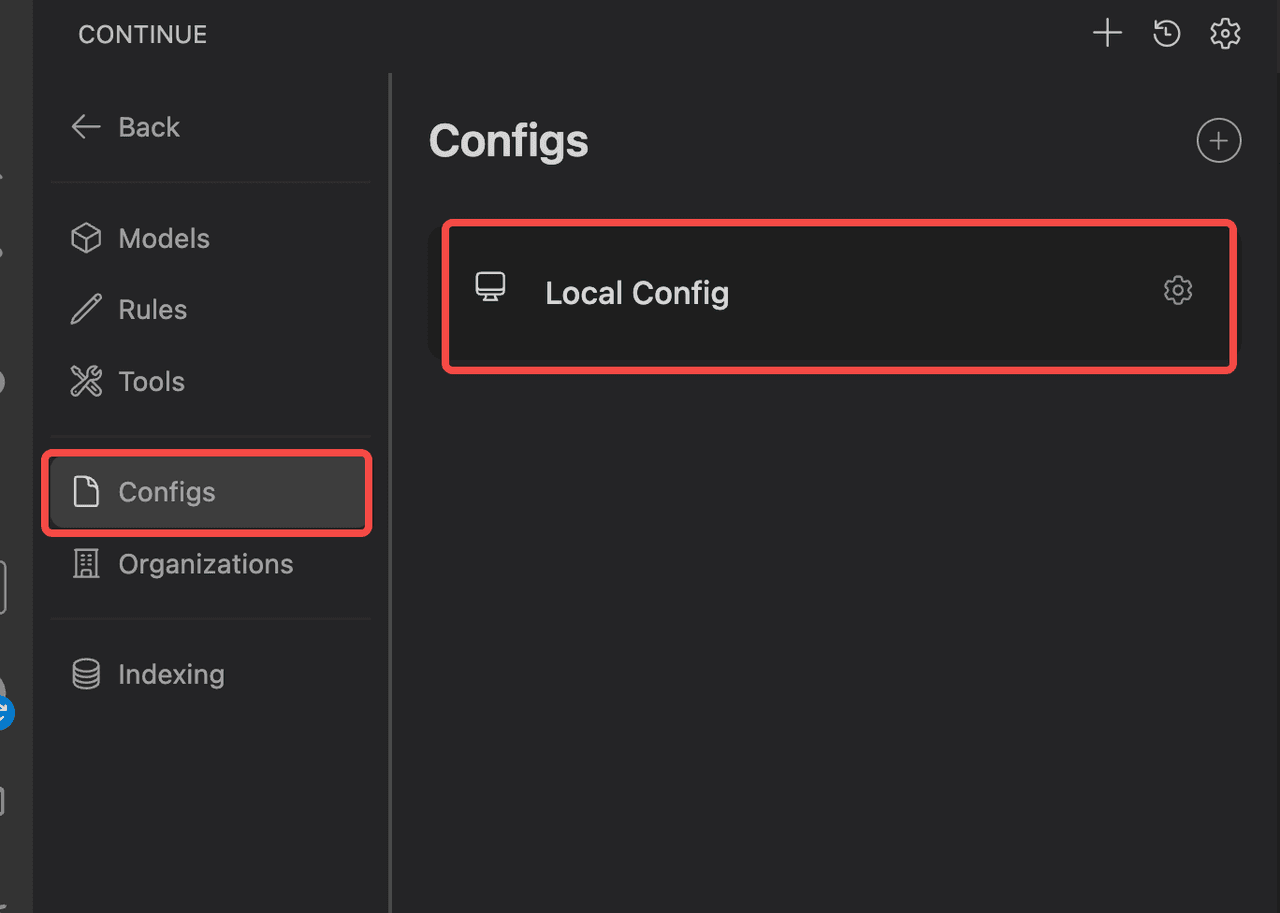

点击设置里的Config,并点击Local Config的设置,打开配置文件

配置文件如下:

name: DO Gradient

version: 1.0.0

schema: v1

models:

- name: Main Chat Model

provider: openai

model: alibaba-qwen3-32b

apiBase: https://inference.do-ai.run/v1

apiKey: ${{ secrets.MODEL_ACCESS_KEY }}

roles:

- chat

- edit

- apply

可以先使用Qwen3-32b调试访问正常后,再切换为Anthropic Claude Opus 4.6,改为:

name: DO Gradient

version: 1.0.0

schema: v1

models:

- name: Main Chat Model

provider: openai

model: anthropic-claude-opus-4.6

apiBase: https://inference.do-ai.run/v1

apiKey: ${{ secrets.MODEL_ACCESS_KEY }}

roles:

- chat

- edit

- apply

可根据需要选择Gradient Serveless Inference上的其他模型,无需更换API Key,本例子中API Key保存在环境变量的MODEL_ACCESS_KEY 变量中,把系统环境变量的值设置成API Key即可。

本例子中未配置自动补全的模型,可以使用VS Code的copilot实现自动补全,免费且响应更快。Claude Opus 4.6更适合代码的Plan和Agent场景,无需在代码补全浪费Token。 Continue插件支持在不同角色下使用不同的模型,实现更加灵活和安全的配置。涉及隐私和机密的数据可以使用本地模型

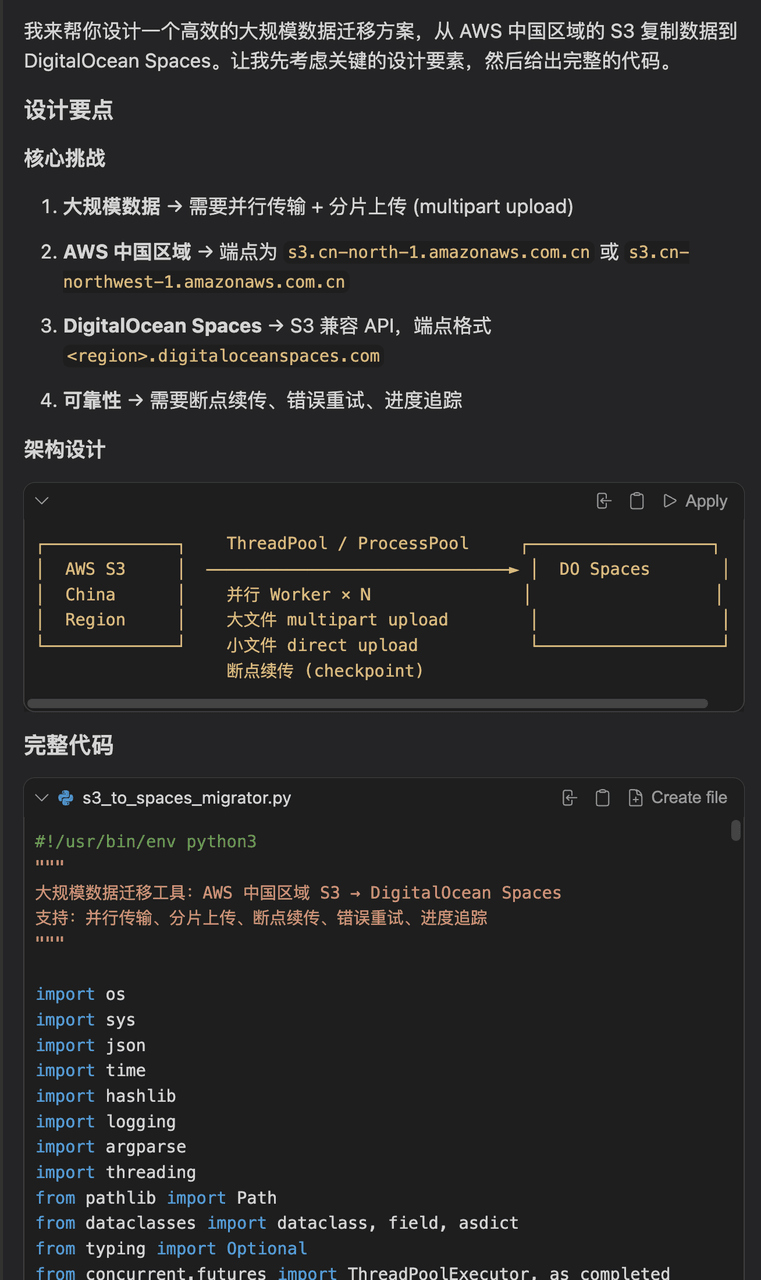

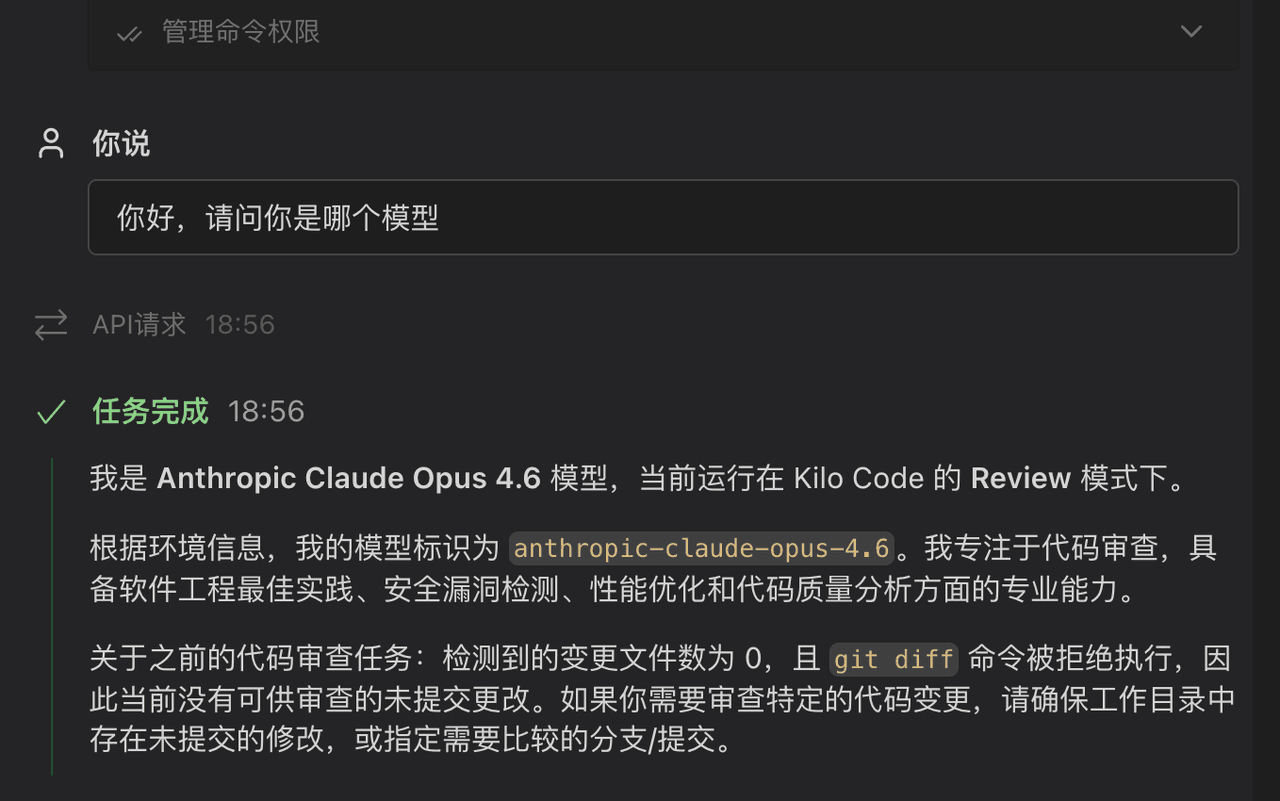

测试用Claude Opus 4.6帮助生成一个数据迁移脚本:

Kilo Code插件配置

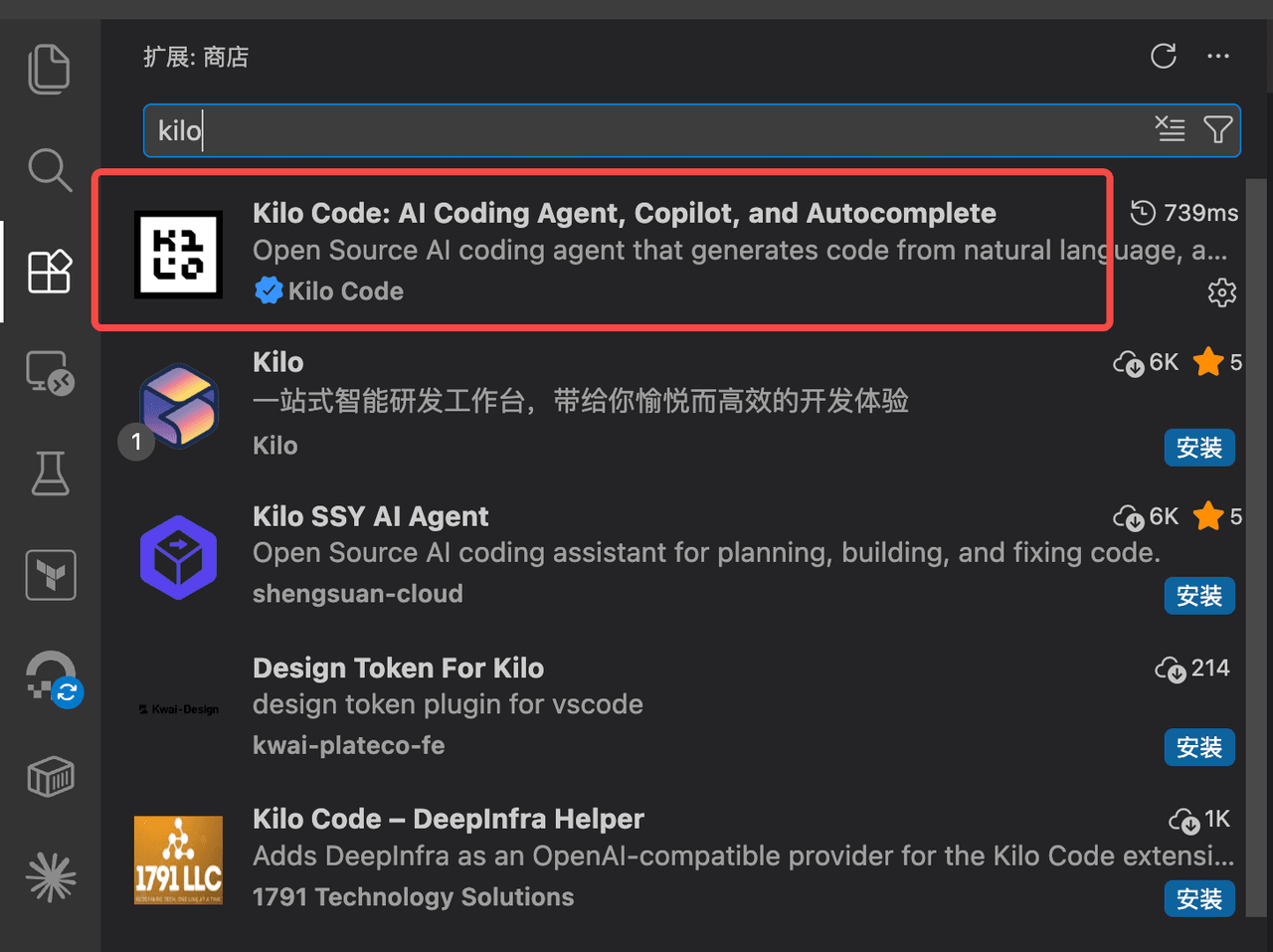

搜索并安装Kilo插件

安装完成后,在左边边栏点击Kilo插件图标,开始配置

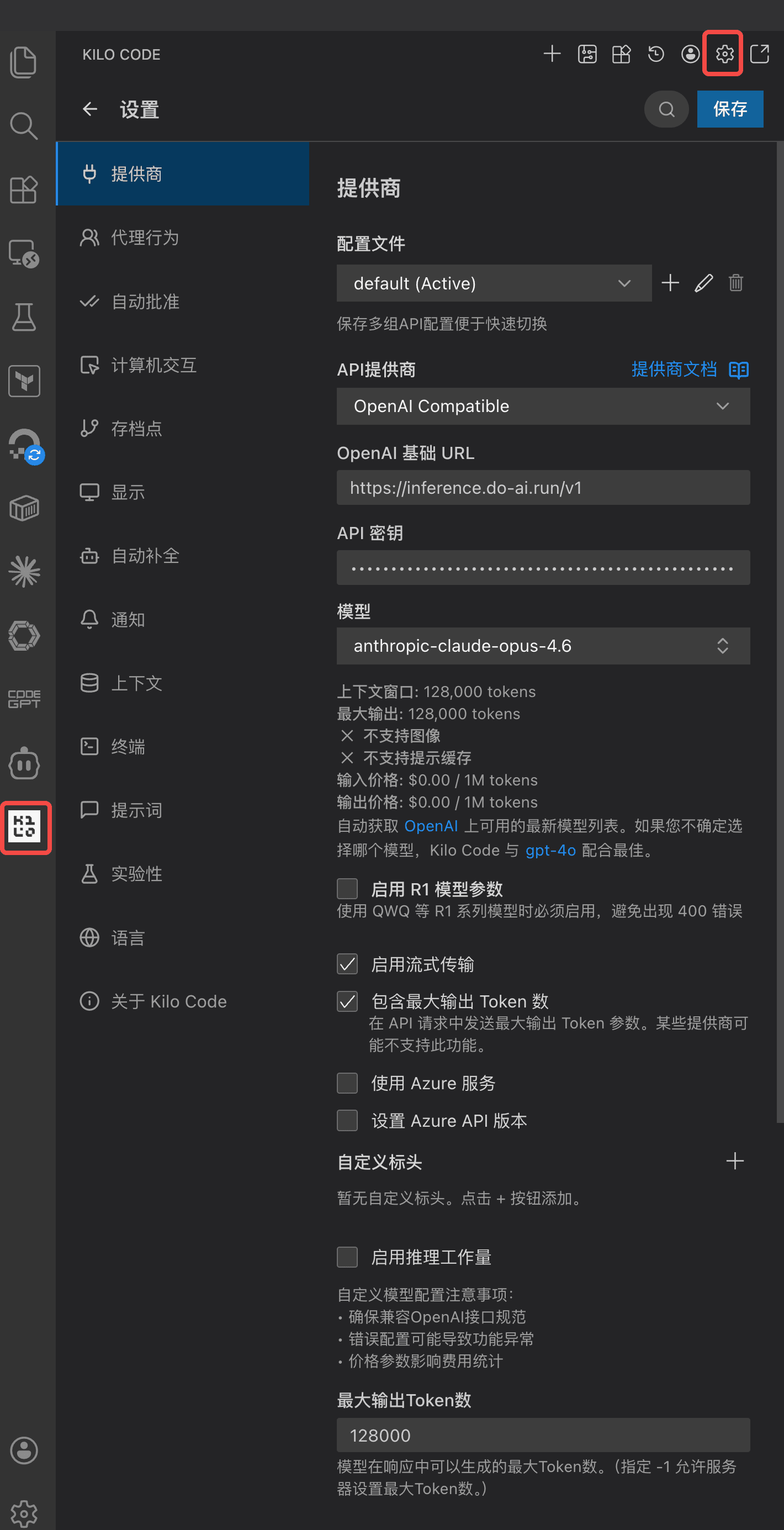

按如上所示配置以下信息:

API 提供商:OpenAI Compatible

OpenAI基础URL: https://inference.do-ai.run/v1

API密钥:DO平台Model Access Key

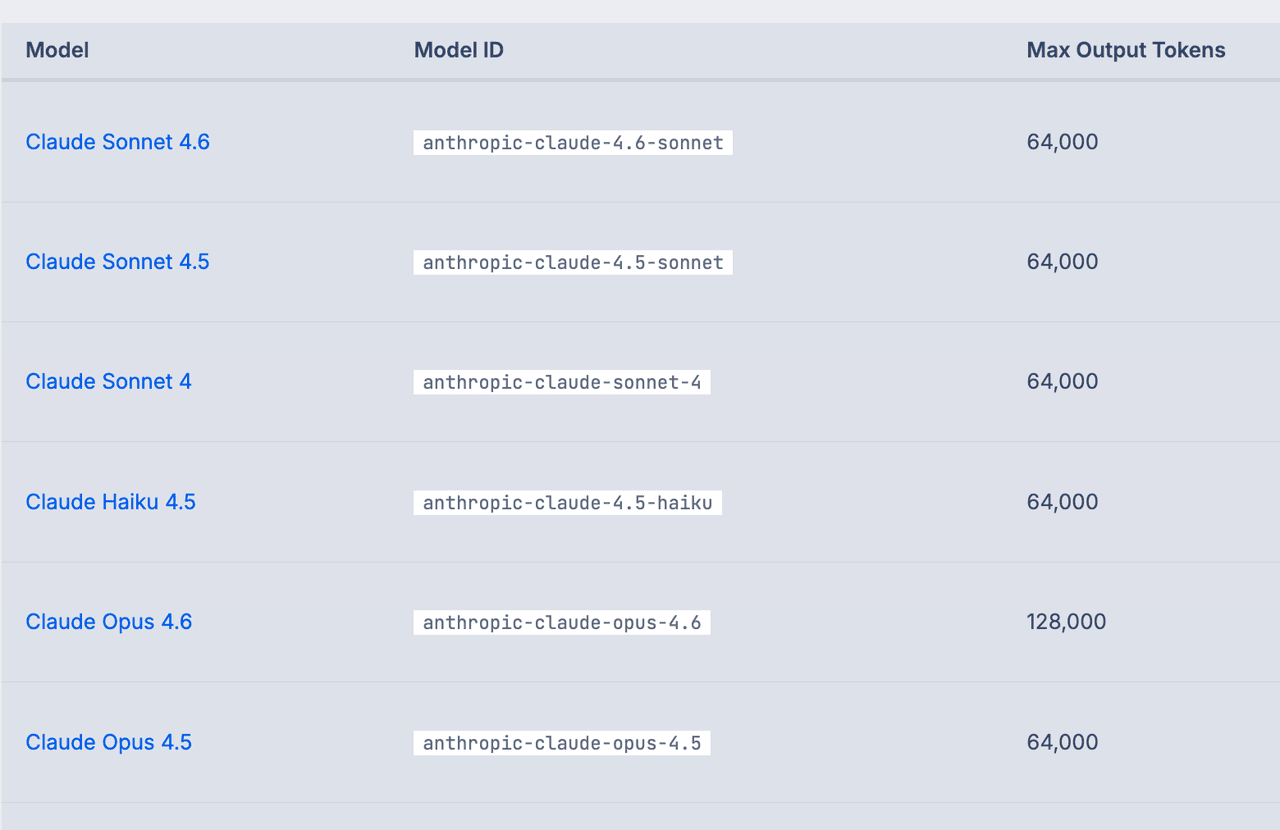

模型:anthropic-claude-opus-4.6

最大输出Token:128000

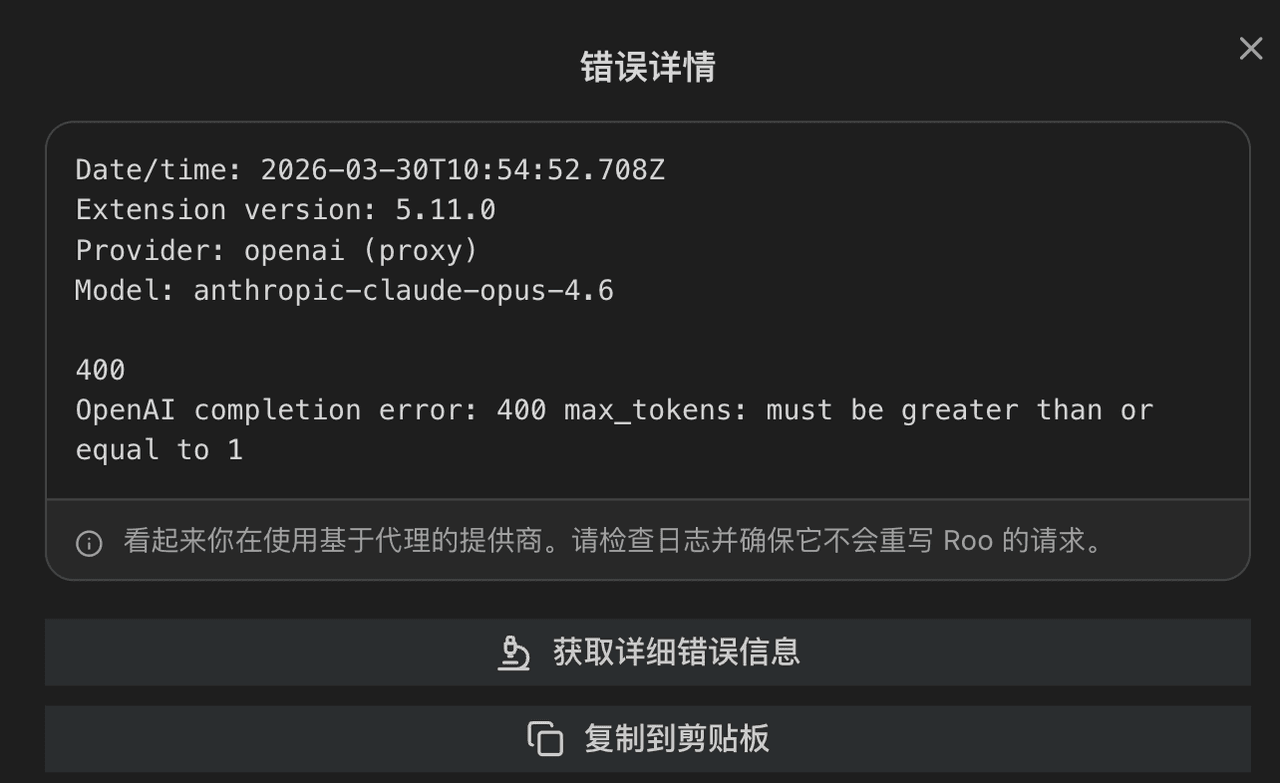

默认的最大输入Token值为-1,会报错,需要改成平台支持的最大Output Tokens

模型ID和最大Token可以参考以下信息: https://docs.digitalocean.com/products/gradient-ai-platform/details/models/

配置成功后,可以开始使用Kilo Code

FAQ:使用中的常见疑难杂症

Q:Gradient 的计费逻辑是怎样的?真的划算吗? A: 它的计费方式是标准的 Pay-as-you-go(按量计费),价格与大模型官方(如 Anthropic)对齐。这对于不经常进行高强度重构、但偶尔需要大模型处理复杂逻辑的开发者非常友好。你不再需要每月死磕 20 刀的固定订阅,用多少扣多少,透明且可控。

Q:既然价格和官方一样,为什么不直接买官方订阅? A: 最大的优势是“多模集合”。在 Gradient 一个平台上,你可以通过同一个 API Key(Access Key)调用不同厂商的模型(Anthropic, Llama, Qwen 等)。配合 Continue 插件的配置,你可以在一个界面里灵活切换,省去了管理多个平台账号和 API 密钥的麻烦。

Q:这个方案会影响 VS Code 的响应速度吗? A: 体验上几乎无感知。Gradient 的 Serverless 推理延迟非常低。

Q:如果配置大模型的时候遇到报错怎么办? 通常来讲,可以在注册DigitalOcean中后先调用Qwen模型来进行测试,再测试其他大模型。如果遇到调用失败,可以直接联系卓普云(aidroplet.com)的技术支持。

总结:构建你的 AI 混合工作流

通过将 DigitalOcean Gradient 推理云服务接入 VS Code,我们实际上构建了一套“混合算力”**工作流:

- 轻量任务本地化:简单的代码提示交给 Copilot 或本地模型。

- 重型任务云端化:涉及跨文件逻辑、架构设计、数据迁移脚本时,直接调用 Gradient 上的 opus 4.6。

- 统一化管理:所有的 API 调用、模型切换和账单支付都集中在 DO 平台,不再需要到处找 Key。

这种“Serverless AI”的配置方式,代表了未来开发者工作流的趋势——不为闲置的订阅买单,只为产生的价值付费。 赶紧去配置你的专属开发助手吧!